Docker Desktop 4.43-მა ახლახან გამოუშვა ძლიერი განახლებების ნაკრები, რომელიც ამარტივებს დეველოპერებისთვის AI მოდელებისა და MCP ხელსაწყოების გაშვებას, მართვას და დაცვას.

Model Runner ახლა მოიცავს მოდელების უკეთეს მართვას, OpenAI API-ის გაფართოებულ თავსებადობას და გაშვების ქცევის წვრილმარცვლოვან კონტროლს. გაუმჯობესებული MCP კატალოგი აადვილებს MCP სერვერების აღმოჩენასა და გამოყენებას, და ახლა მხარს უჭერს თქვენი საკუთარი MCP სერვერების გაგზავნას! ამავდროულად, MCP Toolkit აუმჯობესებს ინტეგრაციას VS Code-თან და GitHub-თან, მათ შორის ჩაშენებული OAuth მხარდაჭერა უსაფრთხო ავთენტიფიკაციისთვის. Gordon, Docker-ის AI აგენტი, ახლა მხარს უჭერს მრავალძაფიან საუბრებს უფრო სწრაფი, ზუსტი პასუხებით. ხოლო ახალი Compose Bridge-ით, შეგიძლიათ ლოკალური compose.yaml ფაილები Kubernetes კონფიგურაციად გადაიყვანოთ ერთი ბრძანებით.

Model Runner-ში მოდელების მართვის ახალი ბრძანებები და OpenAI API-ის გაფართოებული მხარდაჭერა

ეს გამოშვება მოიცავს გაუმჯობესებებს Docker Model Runner-ის მომხმარებლის ინტერფეისში, inference API-ებში და საბოლოო inference ძრავში.

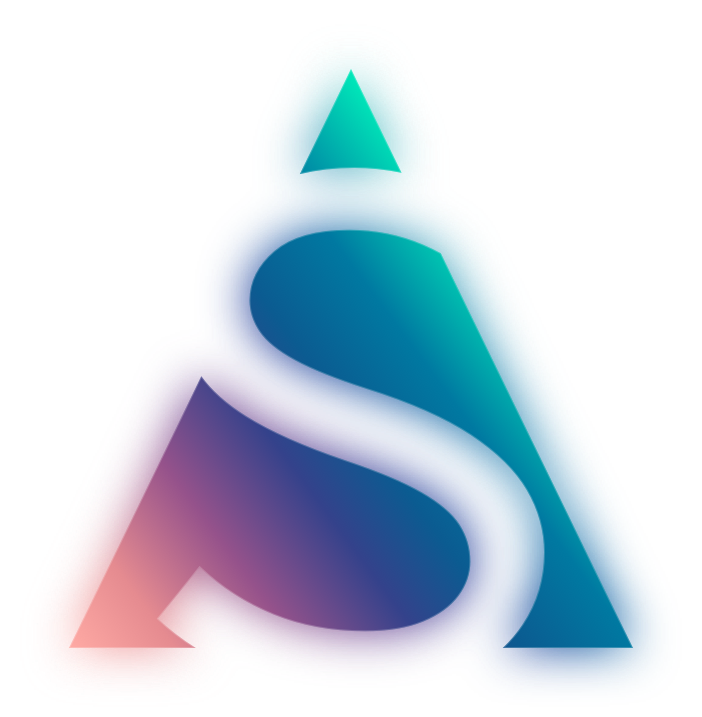

მომხმარებლის ინტერფეისიდან დაწყებული, დეველოპერებს ახლა შეუძლიათ მოდელების შემოწმება (მათ შორის ისეთების, რომლებიც უკვე გადმოწერილია Docker Hub-იდან და ისეთების, რომლებიც დისტანციურად ხელმისაწვდომია AI კატალოგში) უშუალოდ Docker Desktop-ში არსებული მოდელის ბარათების მეშვეობით. ქვემოთ მოცემულია ეკრანის ანაბეჭდი, თუ როგორ გამოიყურება მოდელის ბარათები:

ფიგურა 1: იხილეთ მოდელის ბარათები პირდაპირ Docker Desktop-ში, რათა მიიღოთ მოდელის ოჯახის ყველა ვარიანტისა და მათი ძირითადი მახასიათებლების მყისიერი მიმოხილვა.

- docker model ps: აჩვენებს, რომელი მოდელებია ამჟამად მეხსიერებაში ჩატვირთული

- docker model df: ამოწმებს მოდელებისა და inference ძრავების დისკის გამოყენებას

- docker model unload: ხელით განტვირთავს მოდელს მეხსიერებიდან (უსაქმურობის ვადის გასვლამდე)

WSL2 მომხმარებლებისთვის, რომლებსაც ჩართული აქვთ Docker Desktop ინტეგრაცია, docker model ბრძანებები ახლა ასევე ხელმისაწვდომია მათი WSL2 დისტრიბუციებიდან, რაც აადვილებს მოდელებთან მუშაობას თქვენი Linux-ზე დაფუძნებული სამუშაო პროცესის შეცვლის გარეშე.

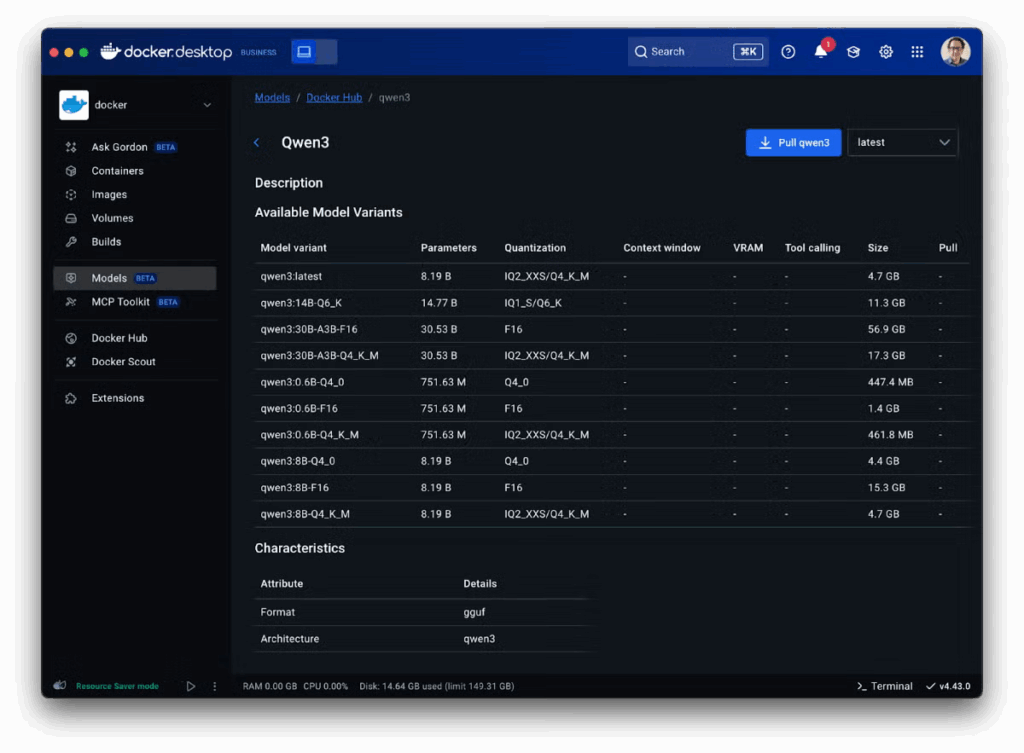

API-ის მხრივ, Model Runner ახლა გთავაზობთ OpenAI API-ის დამატებით თავსებადობას და კონფიგურირებადობას. კონკრეტულად, ხელსაწყოები ახლა მხარდაჭერილია {“stream”: “true”}-ით, რაც Docker Model Runner-ზე აგებულ აგენტებს უფრო დინამიურს და მგრძნობიარეს ხდის. Model Runner-ის API ენდპოინტები ახლა მხარს უჭერს OPTIONS ზარებს არსებულ ხელსაწყოებთან უკეთესი თავსებადობისთვის. და ბოლოს, დეველოპერებს ახლა შეუძლიათ CORS origins-ის კონფიგურაცია Model Runner-ის პარამეტრების პანელში, რაც უზრუნველყოფს უკეთეს თავსებადობას და უსაფრთხოების კონტროლს.

ფიგურა 2: CORS Allowed Origins ახლა კონფიგურირებადია Docker Model Runner-ის პარამეტრებში, რაც დეველოპერებს აძლევს უფრო მეტ მოქნილობასა და კონტროლს.

დეველოპერებისთვის, რომლებსაც სჭირდებათ მოდელის ქცევის წვრილმარცვლოვანი კონტროლი, ჩვენ ასევე წარმოგიდგენთ მოდელის კონტექსტის ზომის და inference ძრავის runtime დროშების დაყენების შესაძლებლობას Docker Compose-ის საშუალებით, მაგალითად:

models:

gemma3:

model: ai/gemma3

context_size: 8192

runtime_flags: ["--no-prefill-assistant"]ამ მაგალითში, ჩვენ ვიყენებთ (არასავალდებულო) context-size და runtime-flags პარამეტრებს, რათა ვაკონტროლოთ inference ძრავის ქცევა. ამ შემთხვევაში, დაკავშირებული runtime არის ნაგულისხმევი (llama.cpp), და დროშების სია შეგიძლიათ იხილოთ აქ. გარკვეულმა დროშებმა შესაძლოა გადაფაროს სტაბილური ნაგულისხმევი კონფიგურაცია, რომელსაც ჩვენ ვაწვდით Docker Desktop-თან ერთად, მაგრამ გვსურს მომხმარებლებს ჰქონდეთ სრული კონტროლი inference backend-ზე. ასევე აღსანიშნავია, რომ კონკრეტულმა მოდელის არქიტექტურამ შესაძლოა შეზღუდოს კონტექსტის მაქსიმალური ზომა. მაქსიმალური კონტექსტის სიგრძის შესახებ ინფორმაცია შეგიძლიათ იხილოთ Docker Hub-ზე არსებულ შესაბამის მოდელის ბარათებზე.

საბოლოო ჯამში, ჩვენ ყურადღება გავამახვილეთ სტაბილურობისა და გამოყენებადობის გაუმჯობესებაზე. ახლა გვაქვს უკეთესი შეცდომების მოხსენება იმ შემთხვევაში, თუ inference პროცესი ჩაიშლება, ასევე ჩავარდნილი ძრავის პროცესების უფრო აგრესიული გაგდება. ჩვენ ასევე გავაუმჯობესეთ Docker CE Model Runner-ის გამოცდილება ერთდროული გამოყენების უკეთესი მართვით და Docker CE-ზე Compose-ში მოდელის პროვაიდერების უფრო მტკიცე მხარდაჭერით.

MCP კატალოგი & Toolkit: უსაფრთხო, კონტეინერიზებული AI ხელსაწყოები მასშტაბით

ახალი და განახლებული MCP კატალოგი

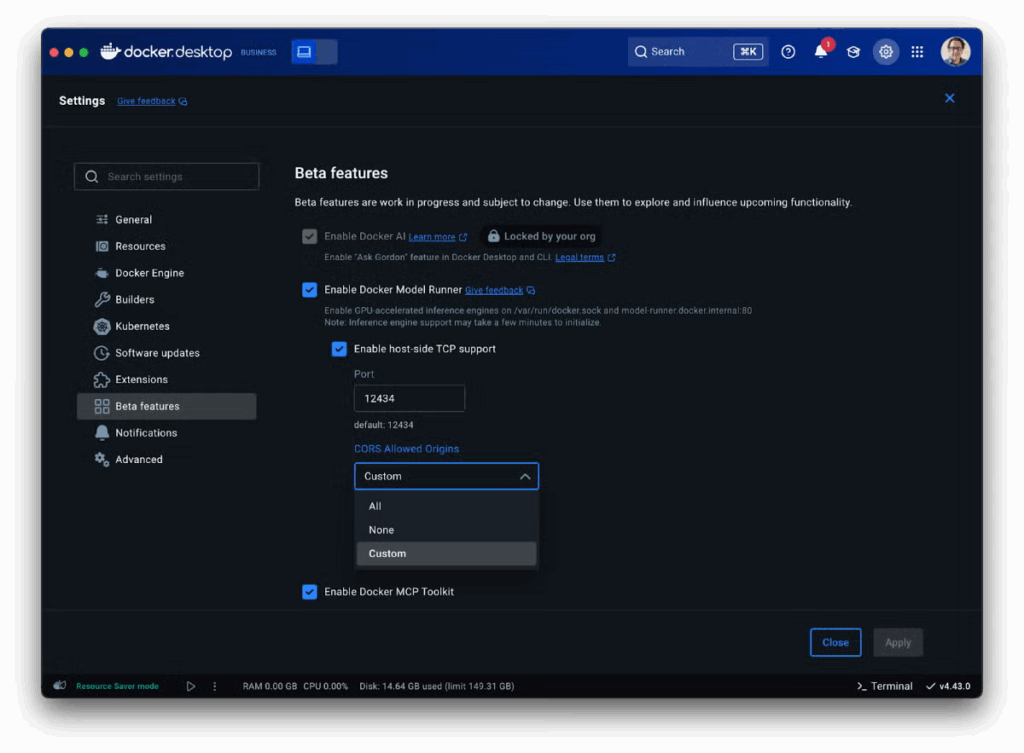

Docker-ის MCP კატალოგი ახლა გთავაზობთ გაუმჯობესებულ გამოცდილებას, რაც აადვილებს თქვენი სამუშაო პროცესებისთვის სწორი MCP სერვერების ძიებას, აღმოჩენასა და იდენტიფიცირებას. კატალოგზე წვდომა კვლავ შეგიძლიათ Docker Hub-ის ან უშუალოდ Docker Desktop-ში MCP Toolkit-ის მეშვეობით, და ახლა ის ასევე ხელმისაწვდომია გამოყოფილი ვებ-ბმულის საშუალებით უფრო სწრაფი წვდომისთვის.

ფიგურა 3: სწრაფად იპოვეთ სწორი MCP სერვერი თქვენი აგენტური აპისთვის და გამოიყენეთ ახალი კატალოგი კონკრეტული გამოყენების შემთხვევების მიხედვით მოსაძებნად.

MCP კატალოგი ამჟამად მოიცავს 100-ზე მეტ დამოწმებულ, კონტეინერიზებულ ხელსაწყოს, ასობით სხვა კი გზაშია. ტრადიციული npx ან uvx სამუშაო პროცესებისგან განსხვავებით, რომლებიც კოდს უშუალოდ თქვენს მასპინძელზე ასრულებენ, კატალოგში არსებული ყოველი MCP სერვერი იზოლირებულ Docker კონტეინერში მუშაობს. თითოეული მათგანი მოიცავს კრიპტოგრაფიულ ხელმოწერებს, მასალების პროგრამულ დაფასებას (SBOM) და წარმოშობის დადასტურებებს.

ეს მიდგომა გამორიცხავს დაუმოწმებელი კოდის გაშვების რისკებს და უზრუნველყოფს თანმიმდევრულ, რეპროდუცირებად გარემოს პლატფორმების მასშტაბით. მიუხედავად იმისა, გჭირდებათ მონაცემთა ბაზის კონექტორები, API ინტეგრაციები თუ განვითარების ხელსაწყოები, MCP კატალოგი უზრუნველყოფს სანდო, მასშტაბირებად საფუძველს AI-ზე დაფუძნებული განვითარების სამუშაო პროცესებისთვის, რომლებიც მთელ ეკოსისტემას სარისკო შესრულების შაბლონებიდან წარმოებისთვის მზა, კონტეინერიზებულ გადაწყვეტილებებისკენ უბიძგებს.

გაგზავნეთ თქვენი MCP სერვერი Docker MCP კატალოგში

ჩვენ ვიწყებთ ახალ წარდგენის პროცესს, რომელიც დეველოპერებს აძლევს მოქნილ ვარიანტებს წვლილის შესატანად, აქ მოცემული პროცესის მიხედვით. დეველოპერებს შეუძლიათ აირჩიონ ორ ვარიანტს შორის: Docker-ის მიერ აგებული და საზოგადოების მიერ აგებული სერვერები.

Docker-ის მიერ აგებული სერვერები

როდესაც ხედავთ „აგებულია Docker-ის მიერ“, თქვენ მიიღებთ ჩვენს სრულ უსაფრთხოების მოპყრობას. ჩვენ ვაკონტროლებთ მთელ აგების კონვეიერს, ვუზრუნველყოფთ კრიპტოგრაფიულ ხელმოწერებს, SBOM-ებს, წარმოშობის დადასტურებებს და უწყვეტ მოწყვლადობის სკანირებას.

საზოგადოების მიერ აგებული სერვერები

ეს სერვერები შეფუთულია როგორც Docker images მათი დეველოპერების მიერ. მიუხედავად იმისა, რომ ჩვენ არ ვაკონტროლებთ მათ აგების პროცესს, მათ მაინც სარგებელს მიღებენ კონტეინერის იზოლაციისგან, რაც უსაფრთხოების მასიური გაუმჯობესებაა უშუალო შესრულებასთან შედარებით.

Docker-ის მიერ აგებული სერვერები უსაფრთხოების ოქროს სტანდარტს აჩვენებენ, ხოლო საზოგადოების მიერ აგებული სერვერები უზრუნველყოფენ, რომ ჩვენ სწრაფად შევძლოთ მასშტაბირება დეველოპერთა მოთხოვნილებების დასაკმაყოფილებლად. დეველოპერებს შეუძლიათ გადაიფიქრონ საზოგადოების მიერ აგებული სერვერის წარდგენის შემდეგ და აირჩიონ მისი ხელახლა წარდგენა, როგორც Docker-ის მიერ აგებული სერვერი.

გახადეთ თქვენი MCP სერვერი დღესვე Docker MCP კატალოგში გამორჩეული და მიაღწიეთ 20 მილიონზე მეტ დეველოპერს. შეიტყვეთ მეტი ჩვენი ახალი MCP კატალოგის შესახებ ჩვენს ანონსის ბლოგში და მიიღეთ ინფორმაცია საუკეთესო პრაქტიკის შესახებ MCP სერვერების აგება, გაშვება და ტესტირება. შემოგვიერთდით უსაფრთხო, კონტეინერიზებული MCP სერვერების უდიდესი ბიბლიოთეკის შექმნაში!

MCP Toolkit ამატებს OAuth მხარდაჭერას და გამარტივებულ ინტეგრაციას GitHub-თან და VS Code-თან

მრავალი MCP სერვერის სერთიფიკატები გადაეცემა როგორც plaintext გარემოს ცვლადები, რაც ავლენს სენსიტიურ მონაცემებს და ზრდის გაჟონვის რისკს. MCP Toolkit აღმოფხვრის ამ რისკს უსაფრთხო სერთიფიკატების შენახვით, რაც საშუალებას აძლევს კლიენტებს ავთენტიფიკაცია MCP სერვერებთან და მესამე მხარის სერვისებთან საიდუმლოებების hardcoding-ის გარეშე. ჩვენ კიდევ უფრო შორს მივდივართ OAuth მხარდაჭერით, დაწყებული ყველაზე ფართოდ გამოყენებული დეველოპერის ხელსაწყოდან, GitHub-იდან. ეს კიდევ უფრო გაამარტივებს უსაფრთხო ავთენტიფიკაციის ინტეგრაციას თქვენს განვითარების სამუშაო პროცესში.

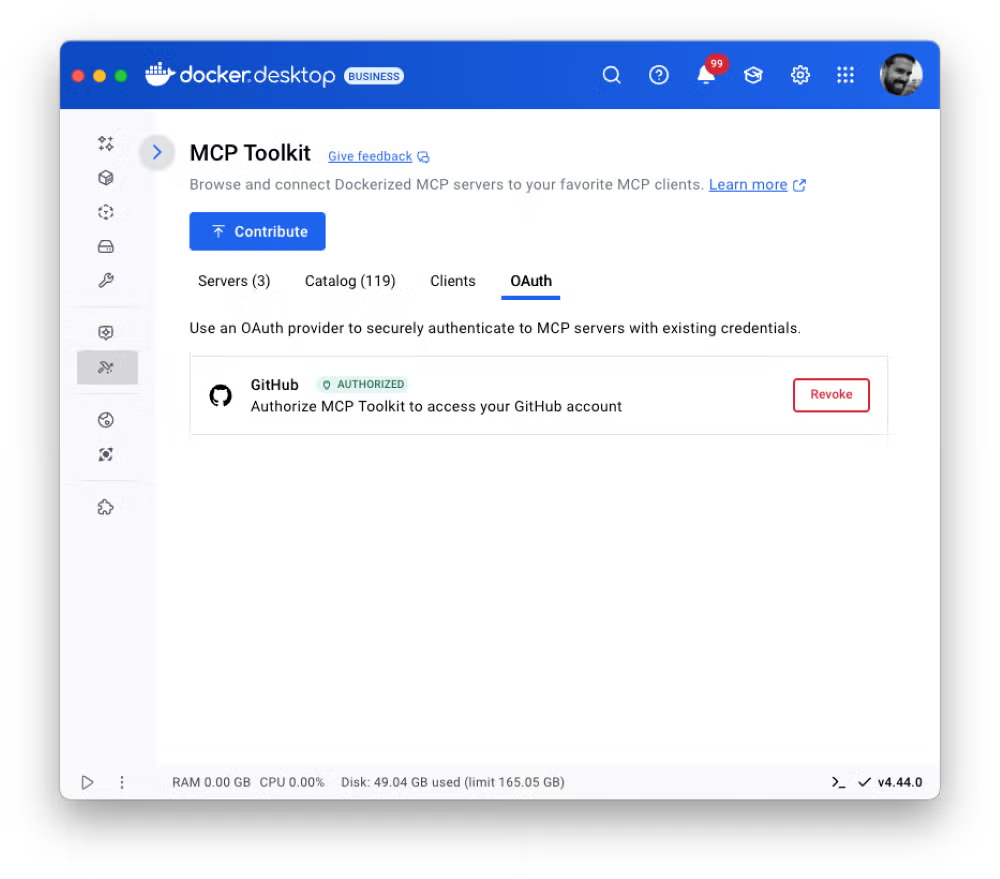

ფიგურა 4: OAuth ახლა მხარდაჭერილია GitHub MCP სერვერისთვის.

თქვენი GitHub MCP სერვერის დასაყენებლად, გადადით OAuth ჩანართზე, დააკავშირეთ თქვენი GitHub ანგარიში, ჩართეთ სერვერი და ავტორიზაცია გაუკეთეთ OAuth-ს უსაფრთხო ავთენტიფიკაციისთვის.

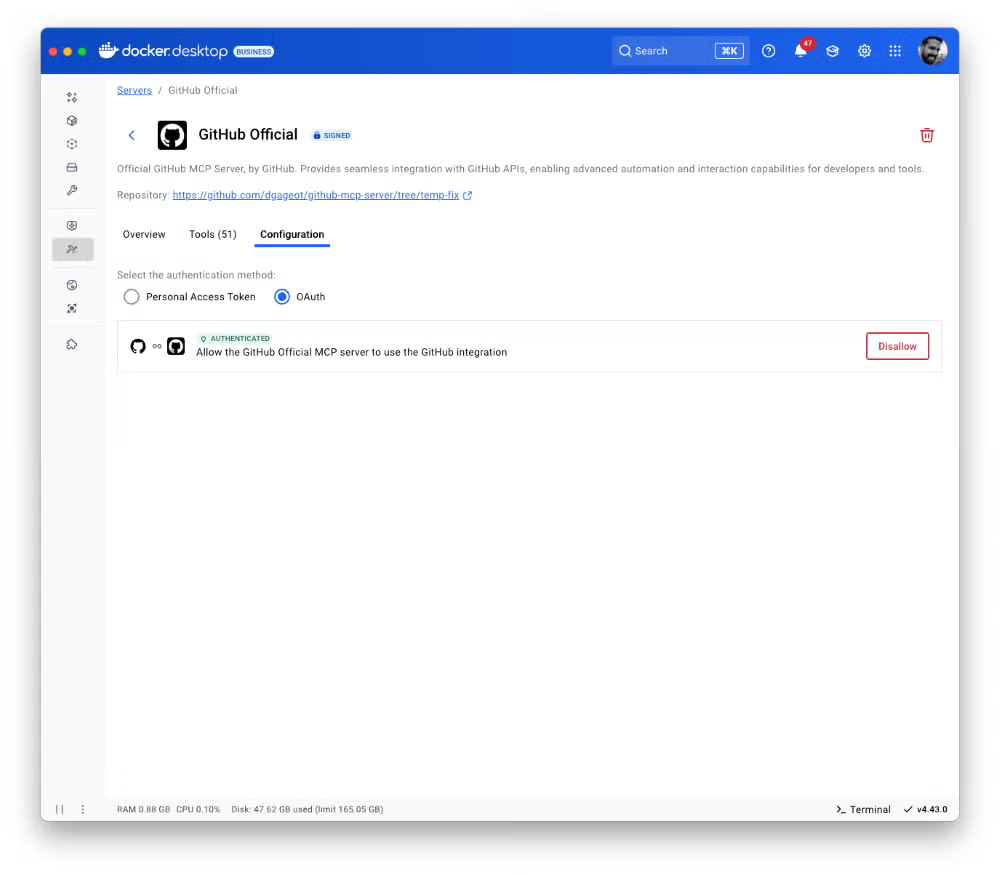

ფიგურა 5: გადადით GitHub MCP სერვერების კონფიგურაციის ჩანართზე, რათა ჩართოთ OAuth უსაფრთხო ავთენტიფიკაციისთვის.

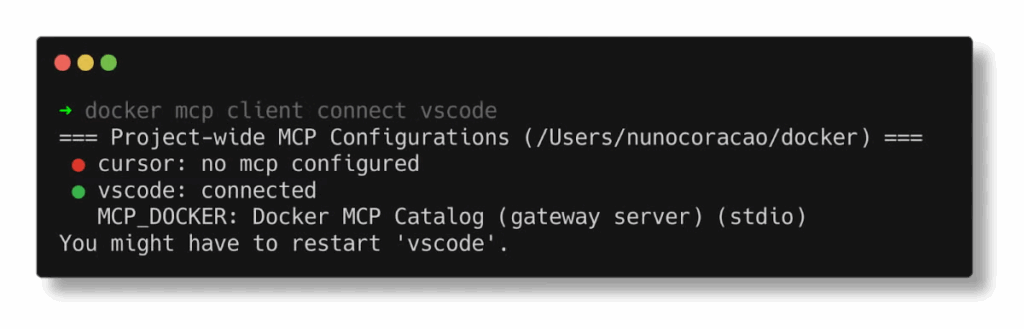

MCP Toolkit საშუალებას გაძლევთ დააკავშიროთ MCP სერვერები ნებისმიერ MCP კლიენტთან, ერთი დაწკაპუნებით კავშირით ისეთ პოპულარულებთან, როგორიცაა Claude და Cursor. ჩვენ ასევე ვუადვილებთ დეველოპერებს VSCode-თან დაკავშირებას docker mcp client connect vscode ბრძანებით. პროექტის ძირეულ საქაღალდეში გაშვებისას, ის ქმნის mcp.json კონფიგურაციის ფაილს თქვენს .vscode საქაღალდეში.

ფიგურა 6: დაუკავშირდით VS Code-ს MCP ბრძანებების საშუალებით CLI-ში.

გარდა ამისა, შეგიძლიათ MCP Toolkit დააკონფიგურიროთ, როგორც გლობალური MCP სერვერი, რომელიც ხელმისაწვდომია VSCode-ისთვის, შემდეგი კონფიგურაციის თქვენს მომხმარებლის პარამეტრებში დამატებით. დამატებითი დეტალებისთვის იხილეთ ეს დოკუმენტი. დაკავშირების შემდეგ, შეგიძლიათ გამოიყენოთ GitHub Copilot აგენტის რეჟიმში სრული წვდომით თქვენს საცავებზე, საკითხებზე და pull request-ებზე.

"mcp": {

"servers": {

"MCP_DOCKER": {

"command": "docker",

"args": [

"mcp",

"gateway",

"run"

],

"type": "stdio"

}

}

}გორდონი ჭკვიანდება: მრავალძაფიანი საუბრები და 5-ჯერ უფრო სწრაფი მუშაობა

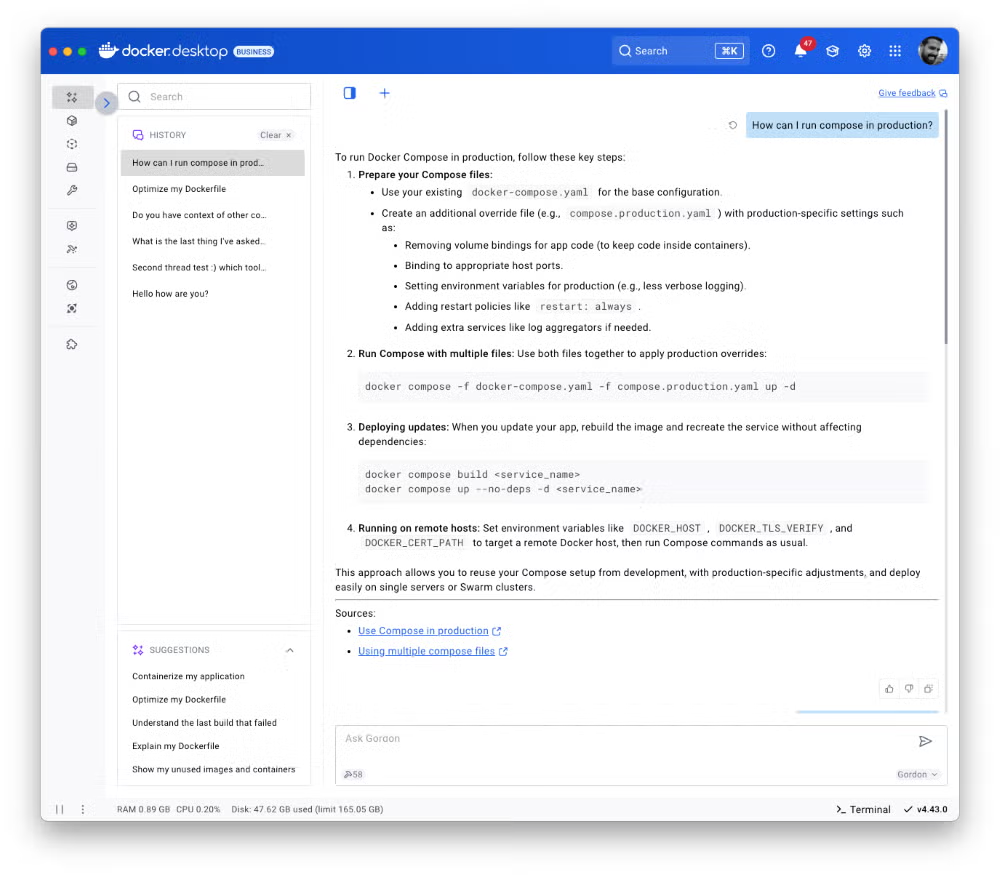

Docker-ის AI აგენტმა გორდონმა ახლახან მიიღო მნიშვნელოვანი განახლება: მრავალძაფიანი საუბრის მხარდაჭერა. ახლა შეგიძლიათ პარალელურად აწარმოოთ მრავალი განსხვავებული საუბარი და გადართოთ თემებს შორის, მაგალითად, კონტეინერის პრობლემის გამართვა ერთ ძაფში და Docker Compose-ის კონფიგურაციის დახვეწა მეორეში, კონტექსტის დაკარგვის გარეშე. გორდონი თითოეულ ძაფს ორგანიზებულად ინახავს, ასე რომ თქვენ შეგიძლიათ გააგრძელოთ ნებისმიერი საუბარი ზუსტად იქიდან, სადაც შეჩერდით.

გორდონის ახალი მრავალძაფიანი შესაძლებლობები მჭიდროდ მუშაობს MCP ხელსაწყოებთან, რაც მნიშვნელოვნად აუმჯობესებს თქვენს განვითარების სამუშაო პროცესს. გამოიყენეთ გორდონი თქვენს საყვარელ MCP ხელსაწყოებთან ერთად, რათა მიიღოთ კონტექსტური დახმარება და შეინარჩუნოთ საუბრები დავალების მიხედვით ორგანიზებული. აღარ არის ფოკუსის დაკარგვა კონტექსტის გადართვის გამო!

ფიგურა 7: გორდონის ახალი მრავალძაფიანი მხარდაჭერა ამცირებს კონტექსტის გადართვას და ზრდის პროდუქტიულობას.

ჩვენ ასევე გამოვუშვით ძირითადი მუშაობის განახლებები, გორდონი ახლა 5-ჯერ სწრაფად პასუხობს და უფრო ზუსტ, კონტექსტზე დაფუძნებულ პასუხებს იძლევა. Docker-ის სპეციფიკური ბრძანებების, კონფიგურაციებისა და პრობლემების აღმოფხვრის სცენარების უკეთესი გაგებით, გორდონი უფრო ჭკვიანი და დამხმარეა, ვიდრე ოდესმე!

Compose Bridge: უპრობლემოდ გადადით ლოკალური Compose-დან Kubernetes-ზე

Compose-ის Kubernetes-ად თარგმნა წამებში

Compose Bridge გთავაზობთ გამარტივებულ, მოქნილ გზას თქვენი Compose აპლიკაციის Kubernetes-ში გადასატანად. ჭკვიანი ნაგულისხმევი პარამეტრებით და კონფიგურაციის ვარიანტებით, ის შექმნილია როგორც მარტივი დაყენებების, ასევე კომპლექსური მიკროსერვისების არქიტექტურების მხარდასაჭერად.

ყველაფერი რაც საჭიროა:

docker compose bridge convertდა აი, Compose Bridge წარმოქმნის შემდეგ Kubernetes რესურსებს თქვენი Compose ფაილიდან:

- Namespace თქვენი განლაგების იზოლირებისთვის

- ConfigMap ყოველი Compose კონფიგურაციის ჩანაწერისთვის

- Deployments თქვენი სერვისების გაშვებისა და მასშტაბირებისთვის

- Services გამოვლენილი და გამოქვეყნებული პორტებისთვის – მათ შორის LoadBalancer სერვისები ჰოსტზე წვდომისთვის

- Secrets თქვენს Compose ფაილში არსებული ნებისმიერი საიდუმლოსთვის (ადგილობრივი გამოყენებისთვის დაშიფრული)

- NetworkPolicies, რომლებიც ასახავს თქვენს Compose ქსელის ტოპოლოგიას

- PersistentVolumeClaims Docker Desktop-ის hostpath საცავის გამოყენებით

ეს მიდგომა სწრაფად და ზუსტად ასახავს თქვენს ლოკალურ დეველოპერულ გარემოს Kubernetes-ში, ასე რომ თქვენ შეგიძლიათ ტესტირება წარმოების მსგავს პირობებში, უფრო სწრაფად.

ჩაშენებული მოქნილობა და მომავალი გაუმჯობესებები

გჭირდებათ რაიმე უფრო მორგებული? Compose Bridge მხარს უჭერს ტრანსფორმაციის გაფართოებულ პარამეტრებს, რათა შეცვალოთ სერვისების ასახვა ან მორგოთ მიღებული კონფიგურაცია თქვენს ინფრასტრუქტურაზე.

და ჩვენ არ ვჩერდებით აქ — მომავალი გამოშვებები Compose Bridge-ს საშუალებას მისცემს, Kubernetes-ის კონფიგურაცია შექმნას თქვენი არსებული კლასტერის პარამეტრების საფუძველზე, რაც გუნდებს დაეხმარება განვითარების წარმოებასთან შესაბამისობაში მოყვანაში ნულიდან მანიფესტების გადაწერის გარეშე.

დასაწყისი

Compose Bridge-ის გამოყენება შეგიძლიათ დღესვე:

- ჩამოტვირთეთ ან განაახლეთ Docker Desktop

- გახსენით თქვენი ტერმინალი და გაუშვით:

- გადახედეთ დოკუმენტაციას კონფიგურაციის ვარიანტების შესასწავლად

docker compose bridge convertდასკვნა

Docker Desktop 4.43 წარმოგიდგენთ პრაქტიკულ განახლებებს დეველოპერებისთვის, რომლებიც ქმნიან AI-სა და cloud-native აპლიკაციების კვეთაზე. მიუხედავად იმისა, თქვენ აწარმოებთ ლოკალურ მოდელებს, ეძებთ და იყენებთ უსაფრთხო MCP სერვერებს, იყენებთ გორდონს მრავალძაფიანი AI დახმარებისთვის, თუ Compose ფაილებს Kubernetes-ში გარდაქმნით, ეს გამოშვება ამცირებს სირთულეს, რათა თქვენ შეძლოთ ფოკუსირება გამოშვებაზე. აგენტური AI პროექტებიდან სამუშაო პროცესების ლოკალურიდან წარმოებამდე მასშტაბირებამდე, თქვენ მიიღებთ მეტ კონტროლს, უფრო გლუვ ინტეგრაციას და ნაკლებ ხელით ნაბიჯებს მთელი პროცესის განმავლობაში.

შეიტყვეთ მეტი

- შეიტყვეთ მეტი ჩვენი ახალი MCP კატალოგის შესახებ.

- გააგზავნეთ თქვენი MCP სერვერები MCP კატალოგში.

- ავთენტიფიკაცია და განახლება დღესვე, რათა მიიღოთ თქვენი სააბონენტო დონის უახლესი Docker Desktop ფუნქციები.

- გამოიწერეთ Docker Navigator Newsletter.

- შეიტყვეთ ჩვენი შესვლის იძულებითი ვარიანტების შესახებ.

- პირველად იყენებთ Docker-ს? შექმენით ანგარიში.

- გაქვთ შეკითხვები? Docker-ის საზოგადოება მზად არის დასახმარებლად.